Par Dmitry Orlov − Le 30 Octobre 2024 − Source Club Orlov

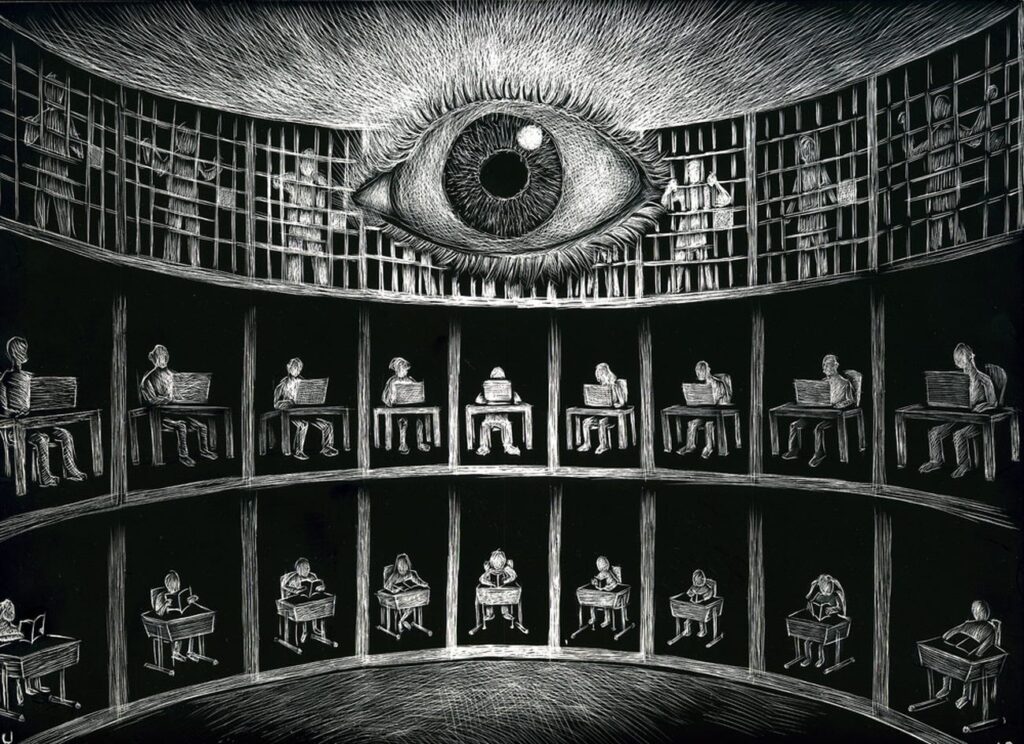

La majeure partie de l’humanité est inconsciente du fait qu’elle vit et se déplace dans un monde de fantasmagorie, dans lequel son sens de l’identité nationale, les lois qu’elle a intériorisées et selon lesquelles elle vit, et même les mots qu’elle utilise pour se décrire, sont déterminés, dans une mesure assez surprenante, non par une quelconque considération rationnelle, mais par les résultats de rituels magiques qui ont été exécutés pour la première fois dans un passé lointain et qui continuent d’être exécutés aujourd’hui. Bien que nous souhaitions nous considérer comme pleinement rationnels et motivés par des calculs d’intérêt personnel et par des conceptions du bien individuel et du bien public, il est assez difficile de nier que nous sommes régulièrement confrontés à diverses formes de psychose de groupe : obsessions, fixations, engouements, attachements émotionnels, dévouements… fanatisme.

L’année prochaine marquera le 230e anniversaire du célèbre essai d’Emmanuel Kant «

L’année prochaine marquera le 230e anniversaire du célèbre essai d’Emmanuel Kant «